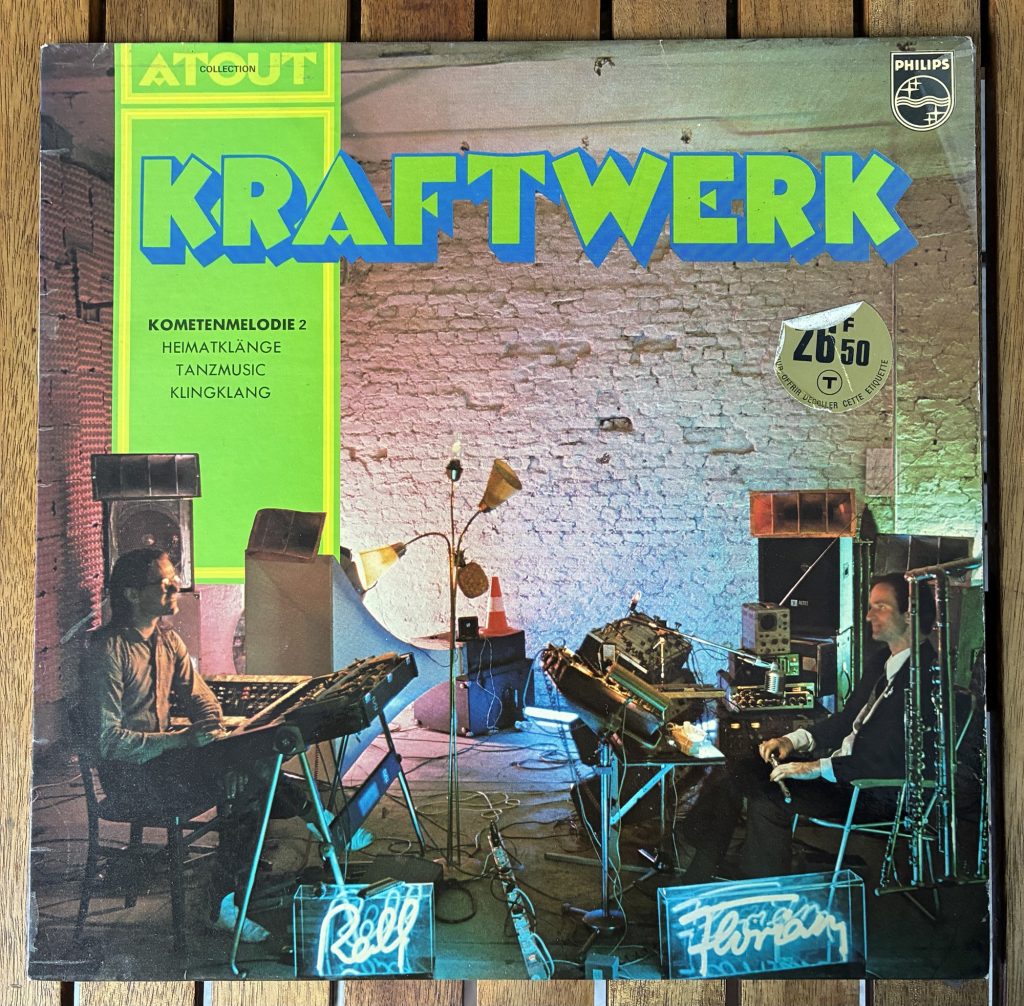

„Einer fehlt auf dem Bild?“ – ein POP-Splitter, gewidmet der ersten Compilation der frühen Kraftwerkler (und einem nahezu unbekannten Bewohner einer digitalen Hüpfburg)

Es ist schon etwas her, da erstanden wir auf dem Flohmarkt eine Schallplatte der Gruppe „Kraftwerk“. Der Bezahlvorgang wurde dereinst von der Gattin mit der Anmerkung, „Wir hätten auch eine Woche Urlaub damit finanzieren können?!?“ begleitet. Wir allerdings waren (mit zittrigen Fingern) rational-ökonomischen Argumenten ausnahmsweise nicht zugänglich und so:

…darauf vier Liedchen. Wenn man sich diese vier Liedchen (nachdem man sich diese selbstverständlich angehört hat!) einmal genauer ansieht, dann wird man feststellen, dass die Erstveröffentlichungen dieser auf drei verschiedenen Alben vorgenommen worden war und wir es somit mit einer waschechten Kompilation zu tun haben! Hier die vier Liedchen im Einzelnen:

1. Kometenmelodie 2

vom dem Album „Autobahn“, das – unter allen Alben dieser Compilation – das zuletzt Erschienene ist (1974) und eben dieses muntere Liedchen beherbergt.

2. Heimatklänge

und

3. Tanzmusic (!, ein „c“)

vom Album „Ralf und Florian“ (1973). Neben einigen Nachlässigkeiten bezüglich der Namensgebung der Schaffenden, ja, sogar bei der Nennung der Jahreszahlen, nun auch das: „Tanzmusik“ mit „c“! Alles auf einer Compilation (siehe dazu auch den discogs-Internetzverbinder weiter unten); war uns „das Große Kosmische“ zu Kopf gestiegen? Wir wissen es nicht, denn bis heute gerieren sich Ralf und Florian (die wir uns hier ausnahmsweise mit deren Vornamen anzusprechen erlauben) eher mimosenhaft bis autistisch, wenn man von ihnen wissen will.

4. Klingklang

vom Album „Kraftwerk 2“ (1972). Als Besserwisser-Quick-Win für die nächste Cocktail-Party: das Kraftwerk-Studio wird „Kling-Klang-Studio“ gerufen.

Aber wer könnte auf dem Cover fehlen? Eine flüchtige Social-Media-Bekanntschaft (Herr Breuer), mit der wir auf einer digitalen Hüpfburg zu parlieren pflegen, preschte wagemutig in die erste Reihe und postete auf eben diese Frage: „Conny Plank“. Auch wenn dieser Mann, Herr Konrad „Conny“ Plank, eben nicht ein Mitglied von Kraftwerk war, so darf man mit Fug behaupten, dass er genau auf jenen ersten vier Alben Kraftwerks einen nicht unbeträchtlichen Einfuß hatte – und nicht zuletzt auch für das ikonische Verkehrshütchen verantwortlich war: das geschah bereits auf dem ersten Album „Kraftwerk“ und wir wollen uns einer Vermutung derer anschliessen, die darauf abzielt, dass Herr Plank/Kraftwerk sich gleichfalls auf Andy Warhols Attitüde, sich an Alltagsgegenständen zu bedienen, kaprizierte:

Nach „Autobahn“ zeichnete sich ein Weg ab, der für Herrn Plank nicht mehr mitzugehen war und man setzte (vielleicht) einen Schlusspunkt mit eben dieser hier im POP-Splitter vorgeführten Compilation. Was aber Herrn Plank nicht arbeitslos machte; doch sein nicht zu unterschätzenden Einfluss auf den „Krautrock“ soll an dieser Stelle nicht weiter ausgebreitet werden.

Es kommt vermutlich nicht von ungefähr, warum in Julien Copes „KrautRockSampler“ eben genau das erste Album Kraftwerks (von dem wir kein Liedchen auf der Compilation haben) Erwähnung findet, allerdings keines der nachfolgenden Alben – war die GROSSE KOSMISCHE MUSIK für Herrn Cope nach dem Erstling verflogen? Wir wissen es nicht…

Die hoffentlich so geweckte, bohrende und gestillt werden wollende Neugierde kann in den weiter unten aufgeführten Internetzverbindern, oder mit Büchlein-Empfehlungen sicherlich Befriedigung finden.

Und: Hören hilft!

jott

Kometenmelodie 2

- die Compilation, Masterrelease auf discogs : https://www.discogs.com/master/228544-Kraftwerk-Kometenmelodie-2

- die Compilation, Französische Veröffentlichung (wie auf dem obigen Bild zu sehen) auf discogs : https://www.discogs.com/release/344946-Kraftwerk-Kometenmelodie-2

- dieses, der Compilation den Namen schenkende Liedchen, ursprünglich auf dem Album „Autobahn“ : Wikipedia : https://de.wikipedia.org/wiki/Autobahn_%28Album%29

Heimatklänge, Tanzmusik, Kompositionen vom Album „Ralf und Florian“ : Wikipedia : https://de.wikipedia.org/wiki/Ralf_und_Florian

Klingklang, eine Komposition vom Album „Kraftwerk 2“ : Wikipedia : https://de.wikipedia.org/wiki/Kraftwerk_2

Kling-Klang-Studio : Wikipedia : https://de.wikipedia.org/wiki/Kling-Klang-Studio

Konrad „Conny“ Plank

- Wikipedia : https://de.wikipedia.org/wiki/Conny_Plank

- Deutsche Biographie : https://www.deutsche-biographie.de/sfzP3731-5.html

Kraftwerk (Synthesizer, Sounds und Samples – die ungewöhnliche Karriere einer deutschen Band), Pascal Bussy, 1995, Piper.

- Deutsche Nationalbibliothek : https://d-nb.info/944757499

- Anmerkung: das Buch gibt es auch in einer neueren Fassung.

KrautRockSampler (One Head’s Guide To The GROSSE KOSMISCHE MUSIK), Julien Cope, Der Grüne Zweig 186, 1996

- Deutsche Nationalbibliothek : https://d-nb.info/950945900

- Popfeed : https://books.popfeed.social/book/9783925817861

- Anmerkung: dieses Buch ist nur noch im Antiquariat zu finden, aber denjenigen unter uns, die sich dem Krautrock nähern wollen, sei es wärmstens empfohlen!

—

Alle Internetzverbinder abgerufen am 09.06.2026

[Zitationshilfe] : „Kometenmelodie 2“, unter jottBlog : <https://jottblog.langkau.name/2026/06/09/kometenmelodie-2/> : aufgerufen am 00.00.20xx.

•#–#–#–#–#•